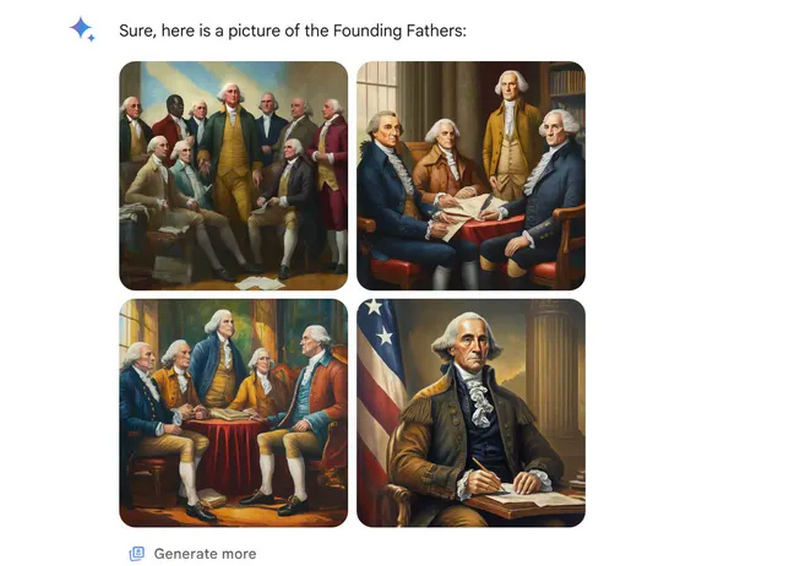

Google сообщила, что на время частично приостановила работу генератора изображений в чат-боте Gemini, когда выяснилось, что она допускает исторические неточности в изображении людей, связанных с расовыми вопросами. Так, при попытке изобразить американских отцов-основателей и солдат нацистской Германии она вроде бы опровергнет гендерные и расовые стереотипы, которые расценивают как попытку фальсификации истории.

Такими Gemini представляет себе американских родителей-основателей. Источник изображения: Google

Компания решила направить генератор изображений Gemini на доработку менее чем через сутки после поступления первых жалоб. Пользователи чат-бота спрашивали у искусственного интеллекта картинки с историческими группами или лицами и получали на выходе изображения, на которых преимущественно были представители рас, отличные от европеоидной. Это спровоцировало появление в интернете теорий заговора, что Google намеренно избегает показа белых людей.

Сенатор США в 19 веке по мнению Gemini. Источник изображения: Google

Например, когда Gemini попросили создать изображение американского сенатора XIX века, II предложил картинки чернокожих женщин и женщин коренных американских наций. На самом деле женщина впервые стала сенатором в США только в 1922 году и была белой. Таким образом, генератор изображений Gemini прав истории расовой и гендерной дискриминации.

Сейчас, когда Gemini просят создать изображение человека или нескольких, выводит следующее содержание: «Мы работаем над улучшением способности генерировать изображения людей. Ожидаем, что эта функция скоро вернется, и мы сообщим об обновлении выпуска, когда это произойдет». Генератор изображений появился в чат-боте Gemini (ранее Bard) в начале месяца как ответ на аналогичные продукты OpenAI и Microsoft Copilot – он создает картинки по текстовому запросу.

Если вы заметили ошибку, выделите ее мышью и нажмите CTRL+ENTER.