Исследователи Массачусетского технологического института (MIT) смогли заметно ускорить создание изображений по текстовым описаниям с помощью генеративного искусственного интеллекта. Новый метод позволяет генерировать изображения высокой четкости в 30 раз быстрее существующих.

Источник изображения: pixabay.com

Обычно в генеративных ИИ применяется техника так называемой «диффузии», когда создается максимально размытая картинка, а затем она детализируется до окончательного результата, максимально отвечающего тому, что ИИ может выдать в ответ на запрос пользователя. Диффузия занимает немало времени, поэтому исследователи MIT поставили своей целью ускорить ее.

Источник изображений: tianweiy.github.io

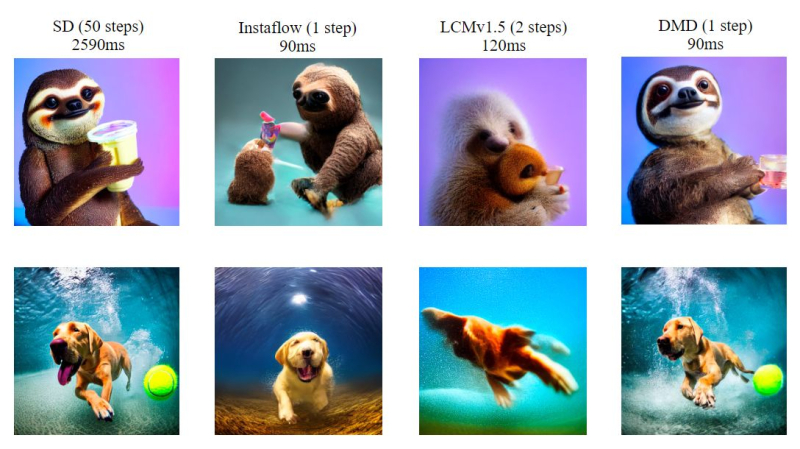

Исследователи из Лаборатории компьютерных наук и искусственного интеллекта MIT свели генерацию изображений в единый проход, а новый метод назвали дистилляцией с согласованным распределением (distribution matching distillation). Очевидно, что генерация картинки в один проход заметно быстрее, чем при типичных для диффузионных моделей 30-50 шагов. Так, на современном оборудовании Stable Diffusion 1.5 создает изображение за 1,5 секунды, тогда как новая модель на основе DMD справляется за 0,05 секунды.

Это не первая попытка дистилляции диффузионных моделей для ускорения создания изображений. В Instaflow и LCM пытались применить схожий подход, но результаты не впечатляли. Компания Stability AI также пыталась ускорить диффузионные модели и добилась некоторых успехов, выпустив Stable Diffusion Turbo, создающую картинку с разрешением до 1 мегапикселя за один проход, однако сгенерированные в несколько проходов изображения все равно получались заметно лучше.

Если вы заметили ошибку, выделите ее мышью и нажмите CTRL+ENTER.